讀者投書

過去一年,AI影像的進展快得令人措手不及。最近更新而快速席捲市場的Gemini 3.0和Nano Banana Pro讓我們驚覺:一張圖片的生成,不再需要攝影師、燈光、模特兒、場景──也不需要等待。

字變正常。臉變一致。光線乾淨得像廣告燈箱。AI正在變得「專業、乾淨、無懈可擊」。

然而愈是完美,人們的反應卻愈詭異:不是驚豔,而是不安。

塑膠般光滑的皮膚、均勻又沒有來源的光、毫無雜訊的臉孔──它們不是不夠真,而是「真得不像真的」。這不是審美問題,而是心理問題。

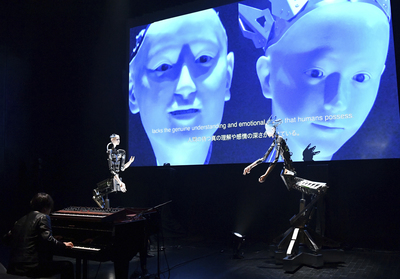

1970年由機器人專家森政弘提出的恐怖谷理論(uncanny valley)認為:當仿真機器人外型與人類相似度愈高時,人們對它的好感度會逐步攀升;但在到達差不多75%的相似度時,好感度會急墜,之後,隨著相似度繼續提升,好感度又會增高。這個好感度的低潮便稱為「恐怖谷」。人形愈逼真,愈容易引發不適。但AI遇到的困境比恐怖谷更複雜。它掉入的不是一個恐怖谷,而是兩個重疊的低谷:第一個是視覺的恐怖谷,第二是認知的恐怖谷,AI同時踏在兩個低谷中。

➊視覺恐怖谷:太像人,卻又不夠像

AI臉太光滑、太乾淨、太無瑕。逼真的不自然,讓我們的大腦亮起第一層警報:「這看起來哪裡怪怪的。」它不像真人,也不像娃娃,是介於兩者之間的奇異產物。這是第一個恐怖谷。

未來,技術遲早會生出毛孔、粉刺、細紋、皮膚紋理。但問題不會因此結束。

➋認知恐怖谷:知道是假的,但它假得太真

最新 MIT(2025)研究顯示:即使AI影像達到極高擬真度,人類仍會因「微瑕疵」與「演算法模擬的人性」而產生不安感,被歸入新的恐怖谷區域。

假設某天AI圖像已經和真實攝影幾乎無法分辨,照理說,它應該跨越恐怖谷,好感度再度上升。但我們的大腦會立刻掉進第二層恐懼:「等一下,你連瑕疵都模擬得出來?你在模仿/取代人嗎?」即使我們知道:毛孔是演算法製造的、光線是模型計算的、紋理是機器生成的。

即使再逼真,我們仍會覺得:不像活的東西。這就是AI的雙重困境:愈像人→視覺恐怖谷變小;愈假裝成真人→認知恐怖谷變深。

恐怖谷障礙不是技術問題,而是心理問題。心理問題最容易被「習慣」侵蝕,人類的適應速度比技術突破還快。但商業不會等待人類心理準備,它會直接略過恐怖谷。行銷、旅遊業、廣告、電商、餐飲、企業簡報⋯⋯每個領域都已經開始使用AI影像,因為太划算了:生成快、成本低、無限修稿、不需要拍攝日、不需要模特兒,甚至不會疲累、不抱怨、不要求合約。

企業即使在意消費者心理──對AI塑膠感的不適,這層顧慮卻很快會被成本效率掩蓋。於是,「AI圖像等於可用影像」會成為新的企業默契。

我們其實早就在日常生活中被訓練,知道哪些能是「做出來的」。在LINE群組,長輩傳的「合成名人圖」常常真假難辨;在選舉中,各國都有AI深偽影像用來影響民意;就連老師也常抱怨「學生的作文乾淨得不像人寫的」。當我們每天都在面對「真假混雜」的資訊和影像流時,我們的心智會疲累到自動切換成:「這張是真是假並不重要,重要的是它能不能用。」

這就是恐怖谷失效的第一步。

恐怖谷的前提是:「我以為是真的,卻發現是假的。」但這個前提正在瓦解。看看Instagram就知道。

修圖、美肌、濾鏡、拉長比例、換天空、去痘、磨皮⋯⋯這些曾被視為「加工」的行為,如今都是尋常日常。也就是說:看著這些「非真圖」的我們都知道:「照片裡的你,不一定就是現實裡的你。」這不是批評,而是成為了一種文化共識。已有研究指出,隨著濾鏡、美肌與後製成為社群日常的一部分,觀者已形成「預期照片會被加工」的心理模型。也就是說,真實性已不是評斷影像的主要標準。

當我們預期影像一定會後製、修整、調色,恐怖谷自然失效。恐怖谷依賴「期待」與「落差」,一旦期待本身消失,恐怖谷也會跟著失效:它不再是不安,而是一種默認。

不遠的未來,影像環境很可能將變成:

- 真人照修到有70%是後製

- AI影像混入照片做修補

- 商業攝影大量使用AI

- 社群貼圖也可能是生成的

- 新聞影像可能包含AI合成

當真假開始混成一團,人類會採用最省力的策略:「既然分不清,那就乾脆不分了。」不是被技術跨越,是被文化習慣磨掉。

這不是個別文化的變化,而是全球性的。歐盟的《人工智慧法》(EU AI Act)要求商業影像必須標示「AI生成」;日本放寬攝影產業規範,允許AI與實拍混用;美國聯邦貿易委員會(FTC)則開始調查深偽影像是否構成「欺瞞性廣告」。

這些政策都指向同一個現象:影像的價值正在離開「真實本身」,轉向「透明」「脈絡」「使用方式」。

人工智慧不會只改變影像生產;它會重塑整個「影像價值」的評斷方式。未來的影像世界不會再問:「這張照片是不是真的?」而會問:「它能不能用?」、「它資訊的可信度是多少?」、「它的上下文是否透明?」、「它的用途是否恰當?」

「真實」不再是最高指標。「可信」、「情境」、「用法」才會構成影像倫理的新核心。

恐怖谷不是AI要跨越的門檻,而是人類文化會自動磨掉的痕跡。

當我們每天被AI圖像包圍、被修圖美照寵壞、被演算法重新定義「自然」,真實將逐漸退位。

AI不需要變得更像人。只要人類不再堅持影像的真實,恐怖谷就會失效。而我們面對AI照片的議題,也將從「心理不適」轉向「如何建立價值」,願前瞻的眼光能幫助我們儘早跨越雙恐怖谷,抵達真正的戰場:影像的倫理、透明、脈絡與信任。

深度求真 眾聲同行

獨立的精神,是自由思想的條件。獨立的媒體,才能守護公共領域,讓自由的討論和真相浮現。

在艱困的媒體環境,《報導者》堅持以非營利組織的模式投入公共領域的調查與深度報導。我們透過讀者的贊助支持來營運,不仰賴商業廣告置入,在獨立自主的前提下,穿梭在各項重要公共議題中。

今年是《報導者》成立十週年,請支持我們持續追蹤國內外新聞事件的真相,度過下一個十年的挑戰。