讀者投書

2019年6月21日,台北市電腦公會與5家國內外的網路平台、廣告業者(Google、Facebook、LINE、Yahoo、PTT)共同發起了「不實訊息防制業者自律實踐準則」(下稱「自律準則」)。自律準則發布的記者會當天,除業者代表到場外,行政院政務委員羅秉成、發言人Kolas Yotaka也到場致詞,一同見證業者自願簽署自律準則的過程。

- 持續建立不實訊息機制與相關防護。

- 持續提升廣告透明與管理機制。

- 與第三方單位及政府合作,建立和維護獨立、透明、公正的監督機制。

- 透過數位素養及媒體識讀相關訓練,協助提升民眾識讀能力。

- 基於惡意欺騙公眾,或創造不當經濟利益之目的

- 而創造、散布可驗證的錯誤事實,或誤導性訊息

- 且有危害民主政治健全運作,或危害公共安全的可能

但問題是,「自律準則」中並未承諾網路平台業者應對內容審查機制進行公開說明、未承諾提供使內容審查機制具公信力的配套機制、僅提及與政府相關單位建立對話、對自律成效過度簡略的描述等,都仍讓我們擔憂,網路平台業者可能為了證明其有落實自律機制,而有侵害公民社會言論自由的風險。

舉例來說,準則在防護不實訊息散布時提及,「將建立標記或關閉虛假帳號的系統或規則」,或者會「儘可能降低不實訊息之出現或出現排序」。在這樣的政策下,顯然將會有帳號遭停權而無法繼續使用,也將有一些內容會比以往更不容易被其他使用者看見。但問題是,外界要如何能得知這些被停權的帳號、不被看見的內容,是出自「正確的」判斷?在這次發布的自律準則中,並未具體承諾會揭露辨識這些假帳號或不實訊息的方法。

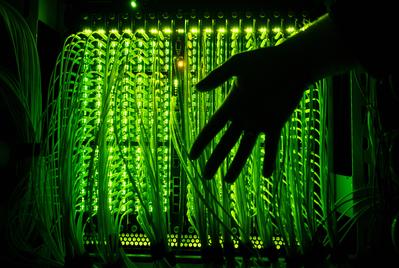

當然也不難猜想,透過演算法(無論是機器學習或人工智慧)進行自動化處理,以識別假帳號的活動或不實資訊,可能會是處理此問題最常見的做法之一。但問題是,早已有文獻清楚說明了自動化處理所具有的各式局限。最常見的局限之一是:用以訓練機器進行自動化處理的資料,可能本身就蘊藏了主流社會的偏見,從而導致在自動化的內容審查過程中,進行錯誤的封鎖或降排序,造成邊緣群體無從發聲的可能(過去的Free The Nipple運動可能是在此的案例之一)。此外,自動化處理在遭遇各種不同語言、知識領域、時空背景交錯下所產生的內容時,是否都能保有一定的精確,也是另一很大的問題。

自動化處理會犯錯,因此不能只倚賴自動化處理。但即使是佐以人工審查(無論只是輔佐自動化處理,或是以人工審查為主)試圖提升精確性,一樣仍有不小的風險。以臉書為例,臉書日前才公開表示,具針對性、在地化的內容,更會仰賴人工審查;但問題是,各審查員是否有足夠的知識脈絡,以判斷訊息的真偽與否?近來更有研究指出,內容審查員是在惡劣的工作環境、身心狀況中工作,在工作條件並未改善前,審查員能否持續保持客觀,做出符合平台服務條款的準確判斷,甚至在各決定之間維持一致的標準,同樣也相當令人憂慮。

網路平台業者有其服務條款,我們或許不能阻止業者自主審查其平台上的內容,但在台灣,當大多數的言論都是經由特定的網路平台進行流通時,網路平台業者就有責任清楚說明內容審查(包含防範不實資訊)所採用的方法為何。畢竟唯有當使用者能具體掌握企業進行內容審查的方法時,才能對其目前所處的言論自由環境,進行有意義的風險評估。

「自律準則」的另一個問題在於,簽署沒有承諾會「提供使內容審查機制具公信力的配套機制」。所謂的「配套機制」包含:是否告知內容發布者其所發表的內容已被視為「不實訊息」、是否有完善的救濟機制、是否公布落實此自律機制的相關資訊等(例如公布因違反服務條款而遭移除或停權的各式內容或帳號數等)。欠缺提供這些配套機制的承諾,自律機制的運作將變得十分不透明,從而難以被監督及課責。

誠如先前所說,無論是仰賴自動化處理或人工,都無法保證內容審查結果的正確性,因此讓內容發布者知道自己的內容已被視為「不實訊息」,從而遭到降排序、特殊標記或移除等措施,是其能否挑戰該審查結果、從而可否取得相應救濟的先決條件。而在救濟過程中,是否有提供有別以往的的審查機制,例如以人工取代原先的機器判斷、是否允許內容發布者提供額外說明、又是否會通知內容發佈者最終審查決定及該決定所依賴的理由等,都將是維繫整個審查機制公信力的關鍵。

- 平台提供者應主動公布因違反其內容審查準則而被永久刪除或暫時停權的貼文及帳號數量。

- 所有用戶都應被明確告知內容審查準則,並針對每一則被永久刪除或暫時停權的貼文及帳號,明確告知該用戶貼文刪除或帳號停權的原因。

- 平台提供者應提供有效的申訴管道,讓用戶可以針對每一則被永久刪除或暫時停權的貼文及帳號,提出異議。

此外,欠缺配套機制,或配套機制失靈的問題,若搭配上「降排序」的處理方式,問題可能會比過往最常採用的「移除」更為棘手,因為內容發布者如今可能根本無法意識到自己發布的內容究竟已消失在多少人的視野中,更無法找到證據證明這件事。

在過去,我們已有過網路平台業者疑似未附移除通知的例子,有過移除說明不夠充分的例子,也有過疑似對特定立場的言論進行過嚴審查的例子。如今,當自律準則對這些配套機制的完善再次毫無承諾時,也等同放任網路平台業者在未來有恣意侵害使用者言論自由的可能。

最後,當前的自律準則在實踐與展望中,僅提及與政府相關單位建立組織性對話,並且也僅概略地提及會公布自律成效等,我們認為不僅是溝通對象遠遠不足,也伴隨著權利侵害風險的可能。

不實訊息在台灣已持續討論了近兩年,我們可以理解在這段期間內,網路平台業者做為主要的利害關係人,承受了諸多來自政府的壓力。但這些大型網路業者所訂定的服務條款、落實的自律機制,影響所及不會只有政府,而是整個台灣的公民社會。網路平台業者不應只把政府視為唯一需要積極對話的對象,而應廣納各方的利害關係人一起參與。

而有關「自律準則」中「定期檢討並公布自律成效」,更是一個意義不明的承諾。在6月21日的記者會裡,羅秉成也表示明年(2020)總統大選將是對此自律準則的「驗收」。但我們必須同時提醒政府及網路平台,重點不在有無驗收,而是誰來驗收、驗收的客觀標準為何。「自律準則」過度簡略了有關自律成效的說明,導致我們無法排除網路平台可能會對自己過度寬鬆,或有意識地在盡量符合政府期待,以避免未來被更嚴苛的法律規範的可能。無論何者,都會對人民的基本權帶來侵害風險。

近來已有愈來愈清楚的研究證實,不實訊息可能正在傷害台灣(或世界各國)的民主體制。網路平台在此議題上若能強化其內容放送與審查機制的透明性與公信力,讓使用者能了解自己為何能接觸到眼前的資訊,當然是值得歡迎的事。然而網路平台的自律若只是為了符合政府期待,以避免後續更嚴格的立法,或沿用過去問題重重且不透明的審查機制,恐怕只會如本文所說,製造更多不願見到的風險。我們呼籲網路平台應聽取上述建議,及早修正「自律準則」的內容。

深度求真 眾聲同行

獨立的精神,是自由思想的條件。獨立的媒體,才能守護公共領域,讓自由的討論和真相浮現。

在艱困的媒體環境,《報導者》堅持以非營利組織的模式投入公共領域的調查與深度報導。我們透過讀者的贊助支持來營運,不仰賴商業廣告置入,在獨立自主的前提下,穿梭在各項重要公共議題中。

今年是《報導者》成立十週年,請支持我們持續追蹤國內外新聞事件的真相,度過下一個十年的挑戰。